✔Люди не смогли отличить созданные нейросетью OpenAI Sora видео от настоящих - «Новости сети»

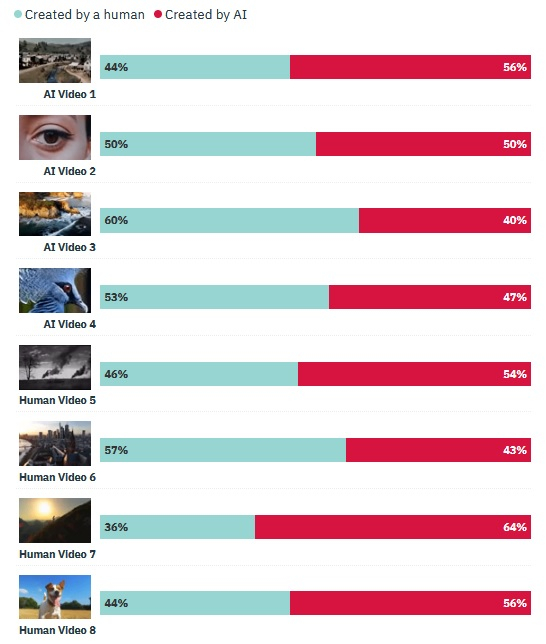

Несколько недель назад компания Open AI представила нейросеть Sora, способную по текстовому описанию генерировать реалистичное видео продолжительностью до одной минуты с разрешением 1920 × 1080 пикселей. Теперь же компания HarrisX провела опрос, предлагая взрослым американцам отличить сгенерированное ИИ видео от настоящего. Оказалось, что большая часть респондентов ошиблась в 5 из 8 предлагаемых в рамках опроса роликов.

Источник изображения: Mariia Shalabaieva / unsplash.com

В опросе, который проходил в период с 1 по 4 марта в США, участвовали более 1000 американцев. Авторы исследования сгенерировали четыре высококачественных ролика с помощью нейросети Sora, а также выбрали четыре небольших видео, которые были сняты на камеру в реальном мире. Респондентам в случайном порядке показывали эти видео, а их цель была определить, снят ролик человеком или его сгенерировал ИИ. Мнения участников опроса разделились, но при этом в 5 из 8 случаев большая часть респондентов дала неверный ответ.

Это исследование указывает на то, что создаваемый с помощью генеративных нейросетей контент становится всё более реалистичным и отличить его от реального всё труднее. Именно поэтому в разных странах стали чаще звучать призывы к властям о необходимости законодательного регулирования этого сегмента. В числе прочего предлагается обязать пользователей нейросетей помечать генерируемый контент соответствующим образом, чтобы он не вводил других в заблуждение и не мог стать источником дезинформации.

Источник изображения: variety.com

Алгоритм Sora ещё недоступен широкой публике, но уже сейчас он вызывает серьёзную тревогу в обществе, особенно в индустрии развлечений, где развитие технологий генерации видео влечёт массу негативных последствий, например, для киностудий. Более того, всё чаще поднимается вопрос о том, что подобные Sora алгоритмы могут использоваться для создания фейковых видео с участием политиков и знаменитостей, что может привести к самым непредсказуемым последствиям.